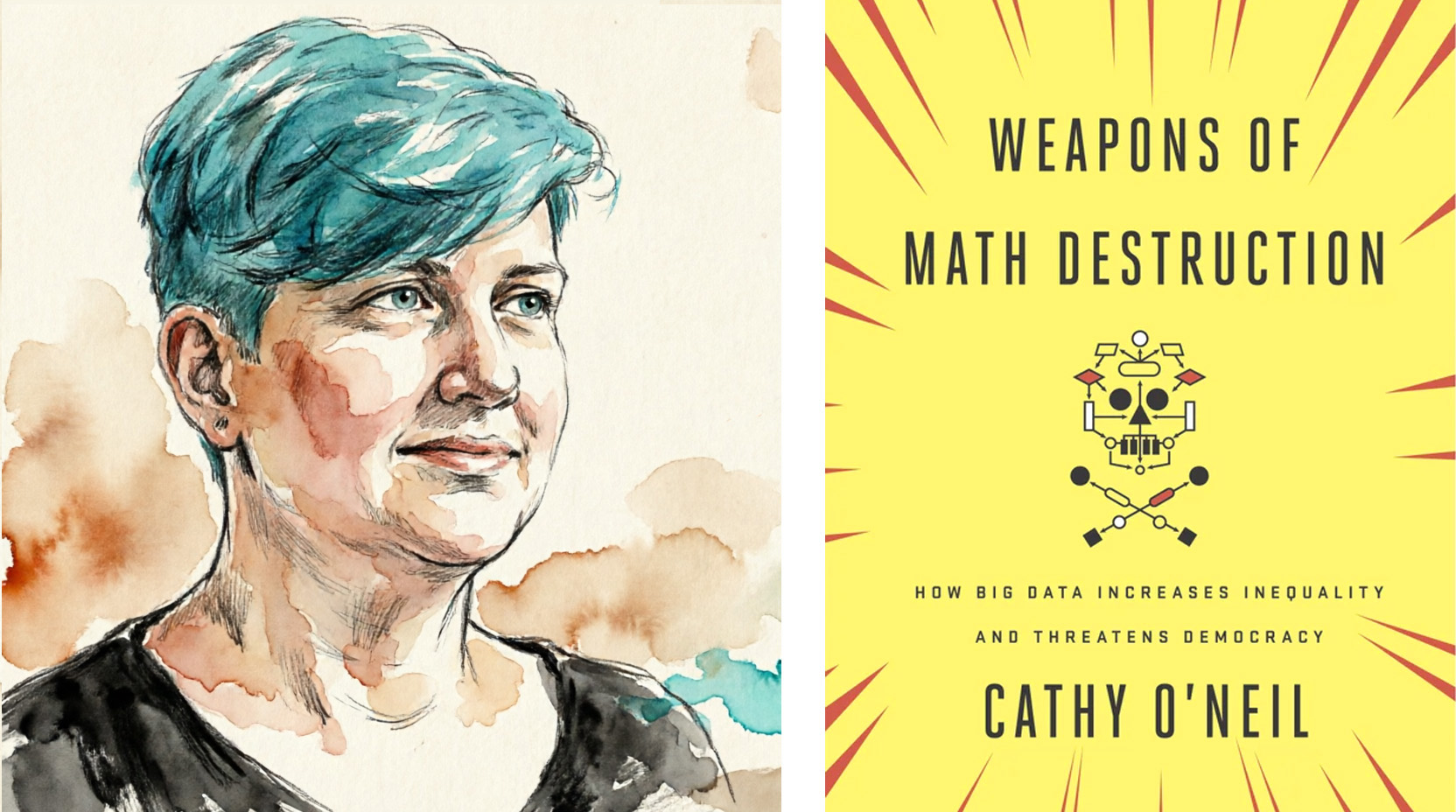

Weapons of Math Destruction di Cathy O'Neil

Cathy O'Neil ha un curriculum che raramente si trova in un solo individuo: dottorato in matematica ad Harvard, anni come quant a Wall Street, poi l'attivismo legato a Occupy Wall Street e, infine, la fondazione di una società dedicata all'auditing degli algoritmi. Questo percorso costituisce la condizione che rende Weapons of Math Destruction un libro credibile, scritto da qualcuno che ha vissuto dall'interno i meccanismi che critica e ha scelto di cambiare prospettiva.

La tesi centrale è semplice nella formulazione, profonda nelle implicazioni: gli algoritmi traducono opinioni in codice. Quando una banca valuta l'affidabilità di un debitore o un distretto scolastico valuta gli insegnanti con un sistema automatico, applica una serie di scelte su cosa misurare, come pesarlo e cosa ignorare. Queste scelte riflettono valori, pregiudizi e interessi specifici. La matematica fornisce una patina di oggettività.

O'Neil chiama questi sistemi Weapons of Math Destruction, le WMD: modelli che operano su larga scala, che funzionano come scatole nere e che producono danni sociali concreti. La definizione si fonda su tre criteri che si combinano in modo preciso: la scala moltiplica le decisioni errate su milioni di persone; l'opacità impedisce contestazioni da parte di chi subisce le conseguenze; i danni restano reali e misurabili, anche se difficilmente attribuibili a una persona specifica. Un algoritmo che nega un mutuo agisce senza lasciare tracce evidenti.

I casi di studio che il libro attraversa coprono un arco ampio: dal credit scoring all'assicurazione sanitaria, dalla selezione del personale nei grandi gruppi aziendali ai modelli di polizia predittiva, dai ranking universitari che distorcono le scelte delle famiglie agli algoritmi di targeting politico che alimentano camere d'eco. In ciascuno di questi contesti emerge un meccanismo ricorrente che O'Neil descrive con lucidità: il feedback loop. Un modello predittivo addestrato su dati storici riproduce le condizioni che quei dati riflettono. Se le forze dell'ordine hanno storicamente concentrato i controlli in certi quartieri, un algoritmo di polizia predittiva addestrato su quei dati indirizza le pattuglie negli stessi luoghi. Si generano più arresti, che confermano la "pericolosità" del quartiere e giustificano ulteriori controlli. Il modello costruisce attivamente la realtà.

Questo meccanismo risulta particolarmente visibile nel capitolo dedicato alla valutazione degli insegnanti, uno dei più riusciti del libro. O'Neil analizza i sistemi di value-added modeling usati negli Stati Uniti per misurare il contributo di un insegnante ai risultati scolastici degli studenti. Questi modelli generano punteggi individuali con decimali che suggeriscono precisione scientifica. La bassa stabilità del sistema permette allo stesso insegnante di oscillare tra eccellenza e sufficienza in anni diversi, senza variazioni nel metodo didattico. A New York un insegnante è stato licenziato sulla base di un punteggio calcolato su ottotré studenti, un campione statisticamente irrilevante per qualsiasi inferenza robusta. La critica al potere delle piattaforme digitali è forse il punto in cui il libro mostra qualche tensione interna. O'Neil descrive come i social media e le grandi piattaforme raccolgano dati su comportamenti, preferenze e vulnerabilità degli utenti per costruire profili usati nel targeting pubblicitario e nella distribuzione selettiva di informazione politica. Il rischio per la democrazia assume contorni concreti: un sistema che mostra a ciascun utente un flusso di informazioni calibrato per massimizzare il coinvolgimento emotivo influenza la qualità del dibattito pubblico. Una maggiore granularità sull'analisi delle differenze tra piattaforme, sui meccanismi di amplificazione e sulla distinzione tra effetti intenzionali e conseguenze involontarie avrebbe arricchito il testo.

Nell'ultimo capitolo O'Neil propone alcune direzioni: regolamentazione dei modelli, obblighi di trasparenza e qualcosa di simile a un giuramento di Ippocrate per i data scientist, un codice deontologico che responsabilizzi chi costruisce questi sistemi. Le proposte aprono una conversazione necessaria. La loro applicazione pratica richiede il superamento di ostacoli tecnici e politici. La regolamentazione algoritmica affronta dinamiche specifiche: il modello muta quotidianamente, opera in giurisdizioni multiple e presenta un'opacità derivante dalla struttura stessa del machine learning. Il percorso di attuazione si presenta complesso.

Weapons of Math Destruction è stato pubblicato nel 2016 e la rapidità con cui i suoi argomenti sono diventati parte del discorso pubblico sulla tecnologia misura il suo peso. Oggi il dibattito sui sistemi algoritmici discriminatori, sulla trasparenza dell'intelligenza artificiale e sull'obbligo di spiegabilità nelle decisioni automatizzate è arrivato nelle aule legislative europee, nelle linee guida delle agenzie di standardizzazione e nei dipartimenti legali delle grandi aziende. O'Neil ha contribuito a formare il vocabolario con cui questo dibattito si svolge. Il concetto di WMD porta alla luce un aspetto fondamentale: ogni modello esprime una scelta e ogni scelta genera conseguenze. L'aura di oggettività matematica oscura spesso questo legame.

La posta in gioco assume una dimensione politica ampia: chi decide cosa misurare, chi ha accesso ai modelli, chi può contestarli, chi subisce le conseguenze degli errori. La matematica tende a oscurare tali interrogativi.

Presidente, Innovation Agency